1.完整项目描述和程序获取

>面包多安全交易平台:https://mbd.pub/o/bread/ZJWcm5tq

>如果链接失效,可以直接打开本站店铺搜索相关店铺:

>如果链接失效,程序调试报错或者项目合作也可以加微信或者QQ联系。

2.部分仿真图预览

3.算法概述

长短期记忆网络(LSTM,Long Short-Term Memory)是一种时间循环神经网络,是为了解决一般的RNN(循环神经网络)存在的长期依赖问题而专门设计出来的,所有的RNN都具有一种重复神经网络模块的链式形式。在标准RNN中,这个重复的结构模块只有一个非常简单的结构,例如一个tanh层。

长短期记忆网络(Long-Short Term Memory,LSTM)论文首次发表于1997年。由于独特的设计结构,LSTM适合于处理和预测时间序列中间隔和延迟非常长的重要事件。LSTM的表现通常比时间递归神经网络及隐马尔科夫模型(HMM)更好,比如用在不分段连续手写识别上。2009年,用LSTM构建的人工神经网络模型赢得过ICDAR手写识别比赛冠军。LSTM还普遍用于自主语音识别,2013年运用TIMIT自然演讲数据库达成17.7%错误率的纪录。作为非线性模型,LSTM可作为复杂的非线性单元用于构造更大型深度神经网络。

LSTM是一种含有LSTM区块(blocks)或其他的一种类神经网络,文献或其他资料中LSTM区块可能被描述成智能网络单元,因为它可以记忆不定时间长度的数值,区块中有一个gate能够决定input是否重要到能被记住及能不能被输出output。图1底下是四个S函数单元,最左边函数依情况可能成为区块的input,右边三个会经过gate决定input是否能传入区块,左边第二个为input gate,如果这里产出近似于零,将把这里的值挡住,不会进到下一层。左边第三个是forget gate,当这产生值近似于零,将把区块里记住的值忘掉。第四个也就是最右边的input为output gate,他可以决定在区块记忆中的input是否能输出 。LSTM有很多个版本,其中一个重要的版本是GRU(Gated Recurrent Unit),根据谷歌的测试表明,LSTM中最重要的是Forget gate,其次是Input gate,最次是Output gate。

4.部分源码

clc;

clear;

close all;

warning off;

addpath(genpath(pwd));

RNN;

LSTM_RNN

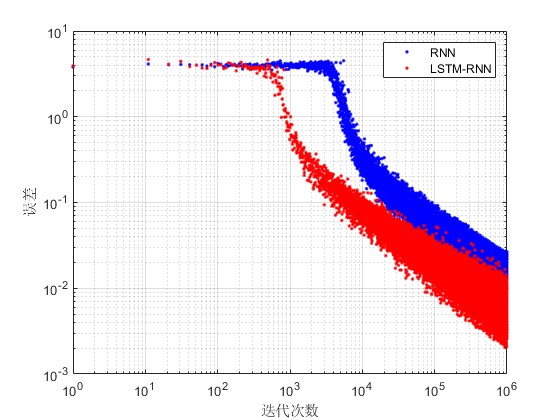

figure

load R1.mat

loglog(1:10:clc_times,errt(1:10:end),'b.');

hold on

load R2.mat

loglog(1:10:clc_times,errt(1:10:end),'r.');

grid on

legend('RNN','LSTM-RNN');

xlabel('迭代次数');

ylabel('误差');

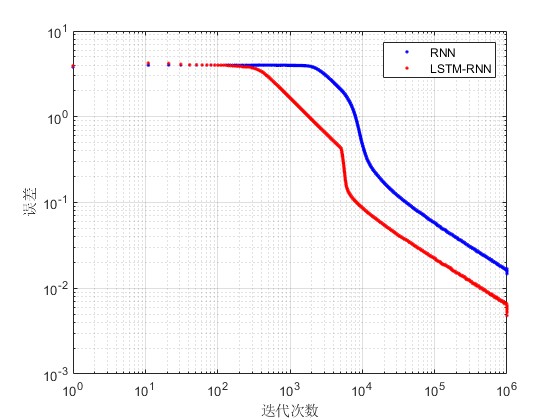

figure

load R1.mat

loglog(1:10:clc_times,smooth(errt(1:10:end),1024),'b.');

hold on

load R2.mat

loglog(1:10:clc_times,smooth(errt(1:10:end),1024),'r.');

grid on

legend('RNN','LSTM-RNN');

xlabel('迭代次数');

ylabel('误差');

A444